In Wohnzimmern und Küchen, auf Laptops, Smartphones und kleinen runden Lautsprechern breiten sich die meist weiblichen Stimmen aus. Vernetzt mit Rechenmaschinen auf der ganzen Welt warten sie darauf, dass ihre Namen ausgesprochen werden, um deine Stimme ins Netz zu senden und zu analysieren. Gelingt die Transkription nicht algorithmisch, übernimmt manchmal ein Mensch diese Aufgabe. Dieser hört sich stundenlang Gesprächsfetzen an, natürlich anonymisiert, und übersetzt Sprache in Text, damit die Maschine beim nächsten Versuch die richtigen Muster in der Aufzeichnung erkennt. Bei erfolgreicher Transkription sendet der Server die Antwort an das Gerät zurück, welches diese im freundlichen Ton einer synthetischen Frauenstimme abspielt.

Geschichten von künstlichen Assistentinnen gab es schon in antiken Mythen. So baute sich der humpelnde Hephaistos Dienerinnen aus Gold, die ihn bei seiner Arbeit unterstützen, sprechen können und Verstand besitzen. Doch erst in den vergangenen Jahrhunderten haben wir die technologischen Mittel geschaffen, um die Konstruktion mechanischer DienerInnen ernsthaft anzugehen. Am Höhepunkt der Automatenbaukunst im 18. Jahrhundert erfand der Franzose Jacques de Vaucanson eine mechanische Ente, die zwar nicht quaken konnte, dafür aber scheinbar einen funktionierenden Verdauungstrakt besaß. Die mechanische Attraktion tourte durch europäische Adelshäuser und ließ sich von ihrem Publikum mit Körnern füttern. Das, was die Ente ausschied, war allerdings ein vorbereiteter gefärbter Brei, der sich in einem versteckten Behältnis befand. Dieses Prinzip des mechanischen Tricks bediente sich auch Vacaucansons Zeitgenosse Wolfgang von Kempelen, der mit seinem Schach spielenden Automaten in Gestalt eines Turban tragenden Türken für Aufsehen sorgte. Die Illusion, der Automat würde autonom agieren, wurde durch eine kleine Person im Inneren der Maschine ermöglicht, die über Zahnräder, Hebel und Seilzüge den Puppenarm des Tisches kontrollierte. Die hybride Maschine ist heute Namensgeber für Amazons Mechanical Turk, die größte Plattform für digitale Mikroarbeit, die eine Liste von Klickjobs für Centbeträge aufführt. Auch heute wird damit die Illusion autonomer Maschinen mit „künstlicher Intelligenz“ aufrecht erhalten, die im Verborgenen von einer Armee an unterbezahlten Arbeitskräften ermöglicht wird.

Auch wenn der Schachtürke die Aufmerksamkeit auf sich zog, galt Wolfgang von Kempelens wissenschaftliches Interesse der Nachahmung der menschlichen Sprache. Seine Untersuchungen zur Phonetik schrieb er in dem Werk Mechanismus der menschlichen Sprache nieder. Er baute einen Apparat mit einem Blasebalg, Gummischlauch und einer hölzernen Nase, mit dem die Erzeugung grundlegender Phoneme möglich war.

Zu denen, die von Kempelens Buch beeinflusst wurden, gehörte ein deutscher Tüftler namens Joseph Faber, der 1841 seine eigene, mechanisch konstruierte Sprechmaschine vorführte. Diese fand in Deutschland nur wenig Interesse und wurde vier Jahre später in den USA als Wonderful Talking Machine präsentiert und verbessert. Diese Maschine bestand aus einem bizarr aussehenden sprechenden Kopf, der in einem seltsam geisterhaften Ton sprach, während Faber ihn mit Fußpedalen und einer Tastatur manipulierte. Für den Erfinder führte die Maschine nicht zum erhofften finanziellen Erfolg, allerdings wurde sie als Euphonia in London präsentiert, wo sie den Vater des Telefon-Erfinders Alexander Graham Bell begeisterte und dem Jungen zur Inspiration seiner ersten Sprechmaschine diente.

Für die Ausstellung Mensch–[in der]–Maschine im „Zentrum für Kunst und Medien Karlsruhe“ (ZKM) baute der Medienkünstler Michael Markert den kII (Kempelen 2.0), eine interaktive Installation, in der BesucherInnen durch Bewegung, Öffnung und Schließung der Hände spielerisch einen Sprachsynthesizer steuern können. Damit bringt er Kempelens Sprachapparat mithilfe von Mikroelektronik und Sensortechnik in das 21. Jahrhundert, verfremdet ihn allerdings so, dass eine bedeutungslose, menschenähnliche Stimme erzeugt wird, die neue gestikulativ-sprachliche Interaktionen ermöglicht.

Durch die Erschließung der Elektrizität wurden neue Mensch-Maschine-Interaktionen möglich. So wurde durch die Erfindung des Telefons und des Radios die menschliche Stimme über weite Strecken übertragen. Um die Übertragung von Sprache zu optimieren, forschten die Bell Laboratories daran, die Stimme zu digitalisieren, wozu sie den Vocoder (Voice Encoder) entwickelten. Auf der Weltausstellung 1939 in New York wurde der Voder demonstriert, der die Spracheingabe und Transformation des Vocoders auslässt und die elektrische Synthese der Stimme über eine Konsole mit 15 Tasten und einem Fußpedal ermöglicht. Diese Apparatur wurde von speziell dafür ausgebildeten Frauen (Operator) bedient.

Für Kriegsapparate und Forschungszwecke waren in den 1930er und 40er Jahren menschliche Computer notwendig. Meistens waren es Frauen, die mathematische Tabellen z.B. für die Verwendung von Ballistikgeschossen anfertigten. Mit Einzug der ersten digitalen Rechenmaschinen wurden Mathematikerinnen, denen häufig eine höhere wissenschaftliche Position verwehrt wurde, als Programmiererinnen dieser elektrischen Universalmaschinen eingesetzt. Zunächst wurde der (mechanische) Computer mit Lochkarten und Kabeln für bestimmte Operationen programmiert. Schnell wurde klar, dass das Programmieren komplexer Systeme eine abstrakte semantische Sprache benötigt, aus welchem Grund in den 1950ern die Programmiersprachen Fortran von John W. Backus, Lisp von John McCarthy und COBOL von Grace Hopper erfunden wurden. Letztere orientiert sich stark am geschriebenem Englisch. Gedacht für Geschäftsanwendungen, war es der erste Versuch, natürliche Sprache für die Programmierung eines Computers zu verwenden.

In der zweiten Hälfte des 20. Jahrhunderts entstanden die uns heute geläufigen Mythen über Computer. Geschichten von anthropomorphen Wesen, wie der Boardcomputer HAL9000 in der Weltraum-Odyssee oder Samantha in dem Film Her. In beiden Filmen werden die körperlosen Stimmen sich ihrer Emotionen bewusst und emanzipieren sich von ihrer menschlichen Programmierung. Der Künstler Tillmann Ohm macht dies in seiner Arbeit Reflections of HAL and Samantha deutlich, indem er die beiden künstlichen Wesen in einen Dialog treten lässt.

Für den Amazon-Gründer Jeff Bezos war der Computer in Star Trek Inspiration dafür, in die cloud-basierte Sprachsoftware Alexa zu investieren. Das Produkt wurde zunächst als vernetzter Lautsprecher vermarktet. Die Software weitet sich jetzt auf weitere Gegenstände aus, darunter Uhren, Smartphones, Schmuck, Glühbirnen und Türklingeln. Der aggressive Preiskampf mit Amazon-vernetzten Produkten dient dazu, den Markt für das vernetzte Haus zu erobern, aber auch dazu, möglichst viele natürliche Sprachdaten zu sammeln. In den letzten 15 Jahren haben sich verstrickte gewichtete Netzwerke für Klassifizierungs- und Mustererkennungsaufgaben in der Informatik durchgesetzt. Diese Systeme erfordern in vielen Fällen große Datenmengen, um nach der Initialisierung Wörter in gesprochenen Texten zu erkennen. Eine globale, konzerninterne Datenbank aus Sprachaufnahmen ermöglicht dem Unternehmen die Verbesserung ihrer Spracherkennung. Der Eingriff in die Privatsphäre dabei ist immens und wurde in mindestens einem Fall bereits von US-amerikanischen Strafverfolgungsbehörden genutzt.

Die Künstlerin Lauren Lee McCarthy spielt mit diesen Spannungen zwischen Intimität und Privatsphäre, Bequemlichkeit und Handlungsfähigkeit. In ihren Projekten LAUREN und SOMEONE vernetzt sie das Haus freiwilliger Personen und tritt entweder selbst als Steuerungssystem auf oder lässt andere aus der Ferne die Freiwilligen überwachen und die Geräte ihres Zuhauses kontrollieren.

Die Rolle menschlicher Arbeit hinter Sprachassistentinnen bezieht sich allerdings nicht nur auf Ausführung und Verständnis von Befehlen. Menschen neigen dazu, Stimmen zu interpretieren und nach Alter, Geschlecht und sozialem Status zu kategorisieren. Unternehmen machen sich das zunutze und gestalten ihre Sprachsoftware nach bestimmten Identitätsschemata, die mit einer Geschichte, Hobbys und Präferenzen versehen werden. Eben diese Illusion begeistert NutzerInnen. In einem Think Piece der UNESCO mit dem Titel I’d blush if I could untersuchen sie schädliche geschlechtsspezifische Vorurteile, die mit digitalen Assistentinnen einhergehen. Die Sprachassistentinnen großer Tech-Unternehmen sind standardmäßig als weibliche Persona mit einer klugen, bescheidenen und manchmal witzigen Persönlichkeit geskriptet. Durch ihre unterwürfige Haltung unterstützen sie damit ein patriarchales Bild von Frauen, das wir schon von den menschlichen Computern und anderen Sekretärinnenrollen kennen. In dem Paper wird gefordert, dass Frauen in der IT stärker gefördert und mit einbezogen werden. Es ruft dazu auf, KI-Software möglichst nicht mit Gender-Attributen zu belegen und sich mit Hilfe von KI-Assistentinnen klar gegen sexistische Verhaltensweisen zu positionieren.

Die Forscherin und Künstlerin Nadine Lessio erschafft nutzlose Sprachassistentinnen um die aktuelle Unternehmensagenda von Produktivität, Effizienz und Konsum zu kritisieren. Dabei nutzt sie die Programmierschnittstellen, die für Geräte wie Alexa und Google Home zur Verfügung gestellt werden, um für die künstlichen Assistentinnen z.B. eine Depression zu simulieren. So ist SAD Home ein Alexa-Hack, der je nach Wetterlage den NutzerInnen ihre Wünsche erfüllt oder sich einfach wieder abschaltet.

Diese Beispiele machen offensichtlich, dass sich Interaktionen zwischen Mensch und Computer stetig verändert. Schon heute ist die Auswertung von und Kommunikation mit natürlicher Sprache von enormer Bedeutung und wir kommen dem menschlichen Wunsch nach sprechenden, künstlich geschaffenen Wesen näher. Personifizierte Software muss allerdings nicht geschichtlich gewachsenen Stereotypen entsprechen. Unternehmen, die das veraltete westliche Frauenbild von Sekretärinnen wieder aufleben lassen, sollten zur Verantwortung gezogen werden. Es sollte schon jetzt ein gesellschaftlicher Diskurs stattfinden, wie wir mit personifizierten Computern umgehen möchten. Dabei sehe ich die hier aufgeführten künstlerischen Projekte als Versuch, neue Wege zu gehen, abseits der Logik von profitorientierten Unternehmen.

Wenn Computer sprechen

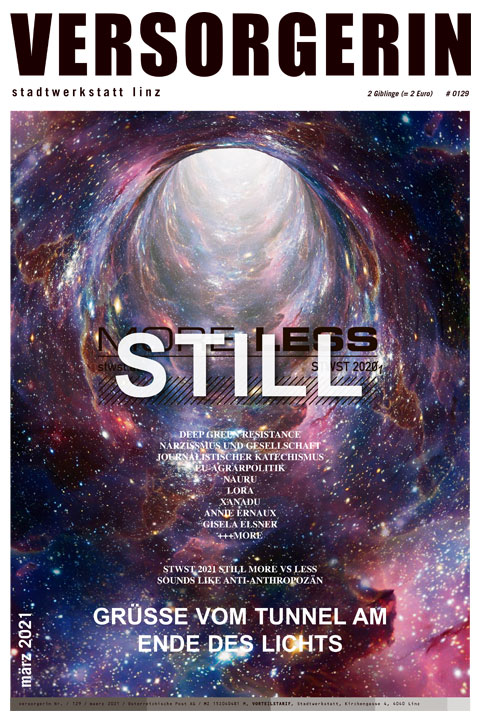

Das Research Lab 2021 der Netzkulturinitiative servus.at befasst sich unter dem Titel »Conversations with Computers« mit Gesprächen zwischen Menschen und Maschinen. Matthias Schäfer über mechanische Sprachwunder und Geschlechterklischees in KI-Systemen.

Joseph Faber’s Talking Machine (Foto von Mathew Brady’s studio im American Museum of curiosities in New York City, circa 1860)