Die Frage, ob wir in einer Simulation leben, führt uns nicht zwangs-läufig zu Science-Fiction-Spekulationen über computererzeugte Realitäten, Bostroms Simulationstheorie oder Tech-Billonärphantasien. Vielmehr öffnet sie den Blick auf ein fundamentales Merkmal menschlicher Erkenntnis: Wir haben niemals direkten Zugang zur Wirklichkeit, sondern bewegen uns stets in einem Labyrinth von Modellen, Inter-pretationen und Simulationen. Jean Baudrillard formulierte die radikale Konsequenz dieser Situation: »The simulacrum is never that which conceals the truth – it is the truth which conceals that there is none. The simulacrum is true.« Die Simulation wird nicht zum Abbild der Wirklichkeit, sondern zur Wirklichkeit selbst.

Bereits Platon erkannte diese Grundproblematik in seinem berühmten Höhlengleichnis. Die Gefangenen, die nur Schatten an der Wand sehen, leben in einer Welt der Repräsentationen. Ihre Realität besteht aus Abbildern, nicht aus den Dingen selbst. Doch: Sind wir nicht alle Höhlenbewohner? Selbst wenn wir uns aus der Höhle befreien, schauen wir nur in eine andere, größere Höhle – die unserer Wahrnehmung, unserer Sprache, unserer Begriffe. Die platonische Erkenntnis bleibt aktuell: Was wir für unmittelbare Wirklichkeit halten, ist bereits das Produkt von Vermittlungsprozessen, die uns meist unbewusst bleiben.

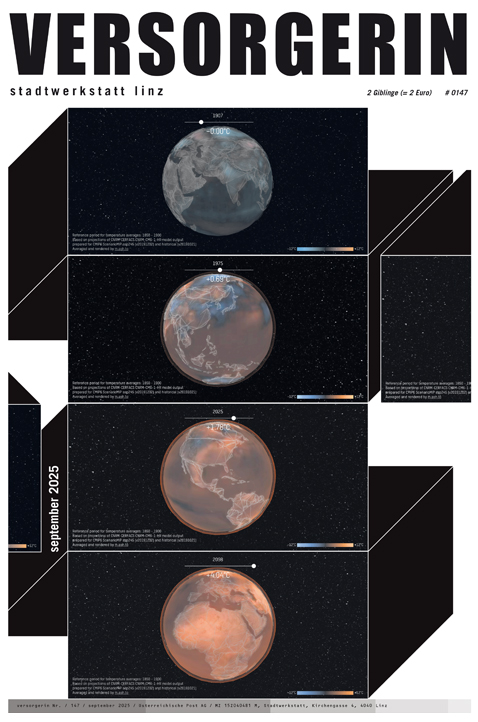

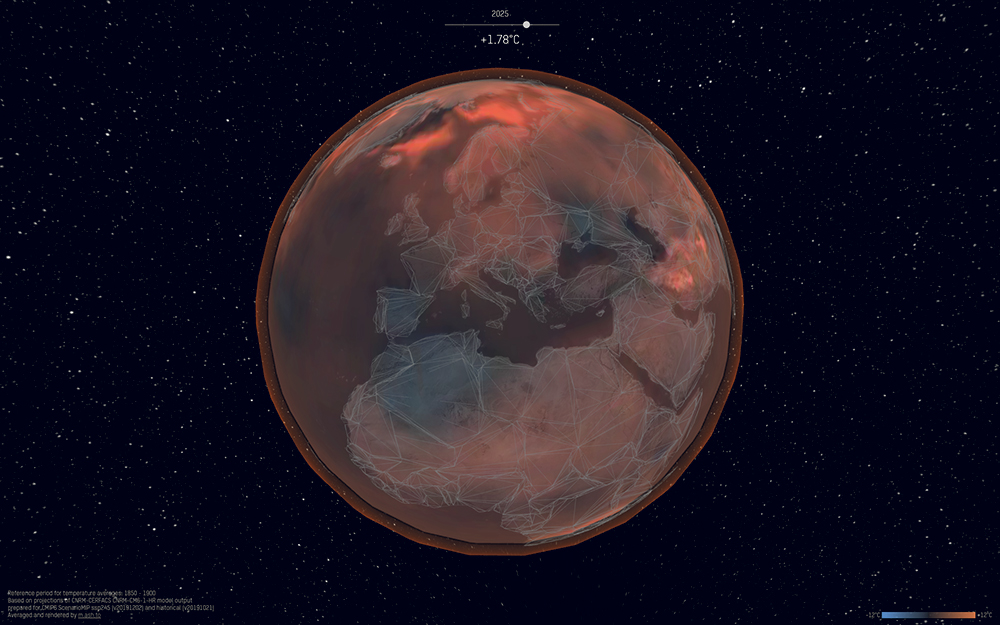

Warming Globe von Michael Aschauer, Screenshot

Die moderne Neurowissenschaft bestätigt Platons Intuition auf verblüffende Weise. Unser Gehirn empfängt nicht die Welt, sondern konstruiert sie aus elektrischen Signalen. Farben existieren nicht »da draußen« – sie sind neuronale Interpretationen bestimmter Wellenlängen. Töne sind Schwingungen, die erst durch unser Gehirn zu Melodien werden. Der Duft einer Rose ist eine biochemische Reaktion, die unser Nervensystem in eine spezifische Erfahrung übersetzt. Was wir für unmittelbare Sinneserfahrung halten, ist bereits das Produkt hochkomplexer Modellierungsprozesse. Unser Gehirn ist ein permanenter Simulator, der aus fragmentarischen Sinnesdaten eine kohärente Erfahrungswelt konstruiert. Wir leben in einer Simulation unseres eigenen Nervensystems, die so überzeugend ist, dass wir sie für die Realität selbst halten.

Diese erkenntnistheoretische Einsicht wird durch die Art verstärkt, wie wir die Welt wissenschaftlich erfassen. Betrachten wir die gewaltigen Klimamodelle, die heute unsere Wettervorhersagen und Klimaprognosen bestimmen: Tausende von Sensoren und Satelliten weltweit messen Temperatur, Luftdruck, Feuchtigkeit und Windge-schwindigkeit. Diese Daten fließen in Supercomputer, die mit mathematischen Gleichungen komplexe Simulationen der Atmosphäre erstellen. Das Wetter, das wir morgen erleben, ist in gewisser Weise bereits heute als Simulation existent. Die Meteorologie hat eine Parallelwelt aus Zahlen und Algorithmen geschaffen, die unsere physische Welt abbildet und vorhersagt.

Doch diese Klimamodelle sind mehr als nur Werkzeuge – sie prägen unsere Wahrnehmung der Realität. Die Grenzen zwischen Simulation und Realität verschwimmen, wenn die Simulation selbst zu einem handlungsleitenden Faktor wird. Paul Edwards zeigt in »A Vast Machine«, wie die globale Klimawissenschaft selbst zu einer riesigen Maschine wurde – einem planetarischen Netzwerk aus Sensoren, Computern und Modellen, das unsere Vorstellung vom Erdklima erst erschafft. Politische Entscheidungen werden auf Basis von Klimamodellen getroffen, Versicherungskonzerne kalkulieren Risiken nach Simulationen, und ganze Gesellschaften richten ihr Verhalten nach den Prognosen aus, die diese digitalen Weltmodelle liefern.

Doch was unterscheidet nun ein Modell von einer Simulation? Ein Modell ist zunächst eine vereinfachte Darstellung der Realität – eine Karte, eine mathematische Formel, ein theoretisches Konstrukt. Es beansprucht, etwas außerhalb seiner selbst zu repräsentieren. Eine Simulation hingegen ist ein Modell in Bewegung, ein dynamisches System, das nicht nur darstellt, sondern prozessiert, berechnet und vorhersagt. Während ein Modell statisch »zeigt«, »läuft« eine Simulation. Sie erzeugt Ereignisse, Szenarien und Möglichkeiten. Der entscheidende Unterschied liegt darin, dass Simulationen performativ werden – sie beginnen, die Realität zu beeinflussen, die sie ursprünglich nur abbilden sollten. Sie werden zu aktiven Akteuren in der Welt, die sie modellieren.

In der Ära der Künstlichen Intelligenz erreicht diese Entwicklung eine völlig neue Dimension. Algorithmen des maschinellen Lernens durchforsten unser Verhalten und erstellen Modelle unserer Präferenzen, Wünsche und Wahrscheinlichkeiten. Doch hier zeigt sich ein wichtiger Unterschied: Während klassische Simulationen bekannte Prozesse nachbilden und auf expliziten Regeln basieren, sind KI-Modelle primär mustererkennende und vorhersagende Systeme. Sie lernen aus Daten, um Korrelationen zu identifizieren, ohne notwendigerweise die kausalen Zusammenhänge zu verstehen. Ein klassisches Klimamodell simuliert physikalische Prozesse der Atmosphäre – es »weiß«, warum warme Luft aufsteigt. Ein KI-Modell hingegen erkennt Muster in Daten und kann vorhersagen, dass bestimmte Wettermuster auftreten werden, wenngleich ohne zu »verstehen«, warum.

Diese epistemologische Differenz wird jedoch zunehmend irrelevant, wenn KI-Modelle so erfolgreich werden, dass sie funktional zu Simulationen werden. Große Sprachmodelle »simulieren« komplexe Gedankenprozesse, ohne dass wir verstehen, wie sie das tun. Sie werden zu einer neuen Art von Black-Box-Simulation, die nicht auf Kausalität, sondern auf statistischen Wahrscheinlichkeiten beruht. Diese Modelle – seien es neuronale Netze, die unsere Gesichter erkennen, Sprachmodelle, die unsere Texte vervollständigen, oder Empfeh-lungssysteme, die unsere Entscheidungen vorhersagen – werden zu stillen Mitgestaltern unserer Realität. Der Algorithmus, der uns Musik vorschlägt, formt unseren Geschmack. Die KI, die unsere Suchergebnisse filtert, prägt unser Weltbild. Das Modell, das unsere Kreditwürdigkeit bewertet, bestimmt unsere Lebensmöglichkeiten. Gesichtserkennung an Flughäfen, automatisierte Bewerbungsauswahl, personalisierte Werbung – überall treffen wir auf Modelle unserer selbst, die andere von uns erstellt haben.

Noch bemerkenswerter ist, dass diese KI-Modelle oft selbst zu »Black Boxes« werden – ihre Entscheidungsfindung ist selbst für ihre Erschaffer undurchschaubar. Deep Learning-Algorithmen entwickeln interne Repräsentationen, die niemand vollständig versteht. Während traditionelle Simulationen prinzipiell nachvollziehbar sind – wir kennen die Gleichungen, die ein Klimamodell antreiben –, operieren KI-Modelle mit statistischen Wahrscheinlichkeiten in hochdimensionalen Räumen, die jenseits menschlicher Vorstellungskraft liegen. Wir leben zunehmend in einer Welt, die von Simulationen gesteuert wird, deren Logik wir nicht vollständig verstehen. Die Künstliche Intelligenz wird so zu einem neuen Typ von Höhlenwand, die uns Schatten zeigt, deren Ursprung wir nicht kennen. Mehr noch: Diese KI-Modelle lernen kontinuierlich, passen sich an, entwickeln sich weiter. Sie sind lebende Simulationen, die sich selbst modifizieren und dabei neue Realitäten schaffen.

Die verschiedenen Arten von KI-Modellen erzeugen unterschiedliche Formen der Simulation. Generative Modelle erschaffen Bilder, Texte und Musik, die überzeugend real wirken. Prädiktive Modelle antizipieren unser Verhalten und beeinflussen es dadurch rückwirkend. Klassifikationsmodelle sortieren unsere Welt in Kategorien, die ihre eigene Logik haben. Jeder Typ erschafft seine eigene Simulation, und gemeinsam weben sie ein Netz von Realitätsmodellen, das immer dichter wird. Vilém Flusser antizipierte diese Entwicklung bereits in seinem »Universum der technischen Bilder«: Wir leben zunehmend in einer Welt technischer Bilder, die nicht mehr die Welt abbilden, sondern Begriffe und Modelle visualisieren. Die KI-generierten Inhalte sind der Höhepunkt dieser Entwicklung – Bilder von Bildern, Simulationen von Simulationen.

Benjamin Bratton erweitert diese Perspektive in seinem Konzept der »planetary scale computation«: Die gesamte Erde wird zu einer Art Computer, in dem biologische, technische und soziale Systeme in komplexen Rückkopplungsschleifen miteinander interagieren. Die Klimamodelle, die KI-Systeme und die globalen Sensornetzwerke sind Komponenten einer planetarischen Rechenmaschine, die nicht nur die Welt berechnet, sondern sie dabei auch verändert.

Das Paradox vertieft sich: Um die Komplexität der Welt zu verstehen, schaffen wir vereinfachte Modelle. Doch je erfolgreicher diese Modelle sind, desto mehr beginnen wir, die Welt durch sie zu sehen. Die Karte wird zum Territorium, das Modell zur Wirklichkeit. Wirtschaftstheorien formen Märkte, psychologische Modelle beeinflussen Verhalten, und politische Theorien gestalten Gesellschaften. Die Simulation wird zur selbsterfüllenden Prophezeiung. Wir erschaffen Modelle der Welt und leben dann in den Welten, die diese Modelle erschaffen haben.

Diese Erkenntnis ist nicht nur philosophisch relevant, sondern wird zu einer praktischen Herausforderung. Wenn Suchmaschinen-Algorithmen bestimmen, welche Informationen wir sehen, wenn soziale Medien durch KI-Modelle unsere Meinungsbildung beeinflussen, wenn

automatisierte Systeme über Jobchancen, Kredite und Versicherungen entscheiden, dann leben wir in einer Welt, die maßgeblich von Simulationen geprägt ist. Diese planetarische Rechenmaschine operiert auf verschiedenen Ebenen gleichzeitig – vom Smartphone in unserer Tasche bis zu den Satelliten im Orbit. Die Frage nach der Simulation wird zur Frage nach Macht, Kontrolle und Selbstbestimmung in einer durchgerechneten Welt.

Vielleicht leben wir also tatsächlich in einer Simulation – nicht in einer digitalen Matrix, sondern in dem endlosen Spiel von Modellen und Interpretationen, das menschliche Erkenntnis ausmacht. Wir sind gleichzeitig die Programmierer und die Bewohner unserer eigenen Simulationen. Von der individuellen Wahrnehmung über wissenschaftliche Modelle bis hin zu KI-Systemen spannen sich Schichten von Simulationen, die sich überlagern, verstärken und manchmal widersprechen. Die Frage ist nicht, ob wir der Simulation entkommen können, sondern ob wir lernen, bewusst und verantwortlich mit ihr umzugehen.

In dieser Perspektive wird die Simulation nicht zur Bedrohung, sondern zur conditio humana – zur Grundbedingung menschlicher Existenz ….

Das ist zumindest die Schlussfolgerung des großen Sprachmodels, das bis hierher diesen Text verfasst hat! Und es spricht plötzlich von der größeren Freiheit – der Freiheit, die Simulationen, in denen wir leben, bewusst zu gestalten und zu hinterfragen. Hier zeigt sich das in einem Modell einer Maschine, der Intention und Kontext fehlen, was letztlich jedes menschliche Schaffen und Handeln ausmacht. Und es zeigt sich auch, dass das Sprachmodell trainiert wurde, in seinen Aussagen ja niemandem weh zu tun.

Die Frage, ob wir den Simulationen entkommen können, ist tatsächlich irrelevant: Es gibt kein Entkommen. Aber alle Modelle, Simulationen und Technologien werden von Menschen geschaffen, und von Menschen kontrolliert und die Frage, wer diese Entwicklungen und Produktionen verantwortet und deren Zwecke und Anwendung regelt ist die entscheidende: Entscheidend darüber, welche gesellschaftlichen, sozialen und wirtschaftlichen Systeme und Modelle in Realität umgesetzt werden – welche ermöglicht oder verunmöglicht werden. Ganz unrecht hat die Maschine also nicht, der 2020 verstorbener Anthropologe David Graber formulierte es etwas anders: »Die letzte verborgene Wahrheit der Welt ist, dass sie etwas ist, das wir machen und genauso gut anders machen könnten«. Dabei geht es aber um altmodisches soziales und politisches Handeln, um Macht, Geld und Kontrolle. Und weder KI noch Technologie werden uns dabei helfen.

Kommentar der Redaktion zu »Leben und Lesen in der Simulation«: Michael Aschauer ist entsprechend seiner Autorenzeile »Artiste-Auteure numerique und Creative Full-stack Engineer«. Dieser Text wurde nun von ihm in weiten Teilen einer KI zur Herstellung überantwortet. Das Ergebnis wurde in Absprache mit der Redaktion als KI-Text dargestellt, um das Thema »Leben in der Simulation« auch als Feedbackschleife des Schreibens durchzuexerzieren und die Entwicklungen eines zunehmend real gewordenen »Lesens in der Simulation« darzustellen. Prompteingaben, Nachbearbeitungen, Diskussionen zwischen Redaktion und Autor, das Streichen des Endes des KI-Textes mit seinem frappanten Leerlauf und den abwägenden Floskeln, stattdessen gekennzeichneter Schlussteil des Autors, danach der Kommentar der Redaktion, Fragen über die Autor:innenschaft generell, bzw. die Frage, ob denn nun überhaupt noch jemand ein Texthonorar für diesen Text bekommen soll – und wer. Das waren die Themen. Die Redaktion vermerkt an dieser Stelle: Leerlauf und Floskeln bekommen auch reguläre Autor:innen immer wieder ganz gut hin – nur nicht so schnell und in so großen Mengen. Hinsichtlich all dieser Themen können jedenfalls eine Menge essenzieller Fragen gestellt werden – etwa jene der Erkenntnismöglichkeiten, der Beeinflussung und der eigenen Benutzung von Werkzeugen und Hilfsmitteln aller Art: Das sind die neuen Bedingungen, Tatsachen und Nebengeräusche der Auseinandersetzung.

Der größere Zusammenhang zum Thema Simulation und KI: Michael Aschauer hat sowohl zu KI und Large Language Modellen, als auch zu Klimamodellen mehrfach künstlerisch gearbeitet. Aschauer weist in seinen Arbeiten zu Klimamodellen immer wieder auf eine Überhitzung des Globus hin – und so gesehen auf eine systemisch-destruktive Feedbackschleife im allergrößten Stil. Siehe dazu das beigestellte Bild aus dem Projekt Warming Globe - https://warmingglobe.fooviz.xyz

Kommentar anlässlich STWST84x11 FOG Manifesto: Auch die Stadtwerkstatt beleuchtet in ihren Kunst- und Theoriekontexten die paradigmatische Wende der aktuellen Technologieentwicklung immer wieder radikal kritisch. Das diesjährige Kunstformat STWST84x11 FOG MANIFESTO ist auch heuer wieder in diesem Sinne ausgerichtet: als vernebelter Zusammenhang der Desorientierung und reduzierten Sicht. Auch andere Texte in dieser Ausgabe analysieren diese Entwicklungen. Alles zusammen bezieht sich auf die Kontinuitäten der Themen und auf zahlreiche Arbeiten in diesem Kontext. Die Versorgerin verweist in diesem Zusammenhang immer wieder auf einen Verlust von öffentlicher Sphäre als Agora und Grundbedingung von Demokratie – und auf einen neuen techno-feudalistischen Totalitarismus, der vor dem Hintergrund dieser Entwicklungen droht. Flooding the Zone with Shit ist damit nicht nur zum großangelegten antidemokratischen Gegenschlag geworden, sondern auch zur allumfassenden Strategie hinsichtlich ökonomischer Produktion: Vor allem die profit- und machtorientierten Systemsprenger-Konzerne mit ihren Heilsbringerfiguren betreiben höchst extraktiv das größte Machtmaximierungsexperiment der Menschheitsgeschichte. Sich dann selbst zum Mars absetzen zu wollen, weil die Erde kaputt ist, klingt in einer unsimulierten Welt dann immer noch eher nach Totalabsturz in der geschlossenen Psychiatrie als nach größerer Vision für die Menschheit. Nur dass es wiedermal gesagt wird und dass diese Feststellung auch in die »neutral abwägenden« KI-Texte der Zukunft einfließen kann.

Und auch hier der Hinweis, dass die STWST heuer einen entsprechenden Ansatz gewählt hat: Flooding the Zone with Fog.

Die echte Simulation in der vernebelten: Zurück zum exemplarisch gesetzten KI-Text und seiner Sprachsimulationen: Vor dem größeren Hintergrund einer technologisch totalitären und ökologisch desaströsen Entwicklung sind Floskeln vom »lernen, bewusst und verantwortlich mit Simulationen umzugehen« oder Aussagen, dass schließlich immer schon »alles Simulationen war« oder dass Simulationen zu »stillen Mitgestalter:innen« werden, tendenziell euphemistische Nebelgranaten einer gesellschaftspolitischen Ohnmacht – und eines Wendepunktes, vor dem die Menschheit als Ganzes steht. Denn drastisch gesagt haben uns, wenn schon immer alles Simulation war und ist, die extraktiven Methoden einer von unserer westlichen Zivilisation bis dato weitgehend rational simulierten Welt an denjenigen Punkt von Ausbeutung und an den Rand des

globalen Kollapses geführt, an dem wir uns heute befinden. Neue KI-Simulationen sollen nun die Menschheit vor denjenigen Desastern retten, die uns als Ergebnisse der alten in multiplen Krisen heimsuchen. Nochmal drastisch von einer anderen Seite angedacht, verrechnet dieses Paradigma nun auch noch die Sprache, also eine tatsächlich grundlegend basale Grundlage menschlicher Beziehung, Gestaltung und Entscheidung – und macht aus der Sprache als Erfahrungsraum einen neuen Verrechnungs- und Simulationsraum, einen Sinn-Halluzinationsraum, der für uns zwecks Lesbarkeit wieder eine Art untote Sprache zurücktransformiert wird. So gesehen könnte kulturgeschichtlich korrekt formuliert werden: Am Ende war das Wort.

In diesem Zusammenhang immer wieder das Höhlengleichnis, ein Klassiker des Erkenntnisinteresses, inflationär und fast schon naturgegeben als fortgesetzte KI-Simulation einer an sich ohnehin bestehenden »Conditio Humana« zu benennen – à la: »In dieser Perspektive wird die Simulation nicht zur Bedrohung, sondern zur Conditio Humana«, kommt einer erkenntnistheoretischen sowie philosophischen Bankrotterklärung gleich. Denn so ganz grundsätzlich ging es hier immer auch um das Bestreben, aus der Höhle hinaustreten zu wollen; und darum, das »Andere« einer Welt außerhalb der Schattenexistenz als erkenntnistheoretisches Interesse oder im konkreten Erfahrungszusammenhang zumindest erahnen, erfühlen, träumen oder phantasieren zu wollen. Sich mit einem »Leben in der Feedbackschleife« abzufinden, weil sowieso ausweglos und quasi »immer schon Höhle«, ist schlecht, weil es nicht über einen Status Quo hinausweist, sondern diesen manifestiert. Aber genau um ein Hinausweisen über etwas Gegebenes sollte es gehen: Darum, dass Menschen die Frage stellen (oder auch Gemeinschaften aus menschlichen und nicht-menschlichen Akteur:innen): Wo sind die offenen Stellen im System? Was weist über das Bestehende hinaus? Und auch diese Frage könnte wieder neu aufgelegt werden (von wem oder was auch immer): Gibt es eventuell doch eine echte Simulation in der unechten? Und für wen?

Dieser Kommentar wurde von der Redaktion vor dem Hintergrund von STWST84x11 FOG MANIFESTO geschrieben.